最快达成角色一致性的路径

“开挂”级核心功能

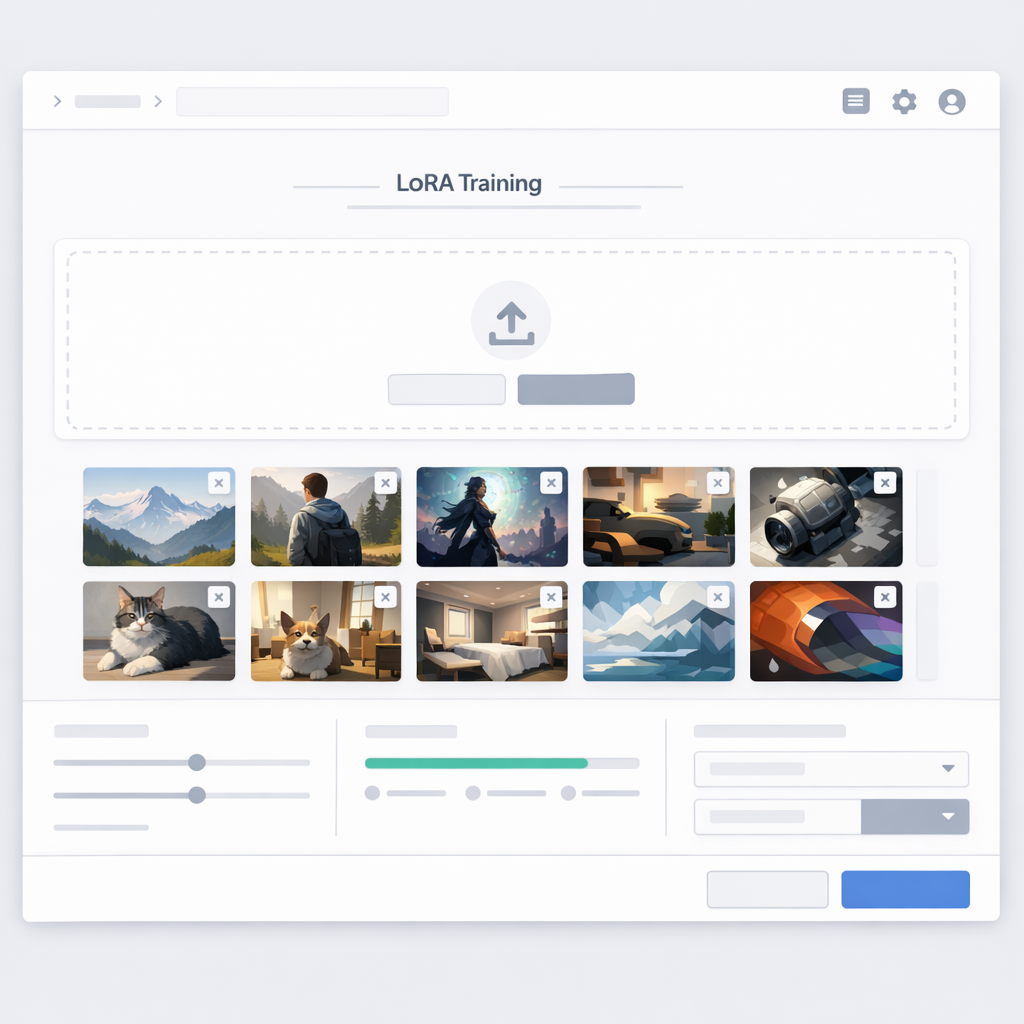

LoRA训练:为生产环境带来真正一致的自定义角色模型。

什么是LoRA训练?

LoRA(低秩适应)是一种参数高效的微调技术,可以在不改动数百万核心权重的情况下让现有模型获得新知识。它通过添加小巧的适配层,大幅降低算力需求,并实现高保真度。你可以把它想象成训练一位AI画家,学会并持续复现你角色的DNA:脸部比例、表情、配饰、风格要素。仅凭10–30张精选图片,就能解锁无限一致的漫画分镜、游戏资产、分镜图和品牌角色的生成。

Get started for free

为什么角色一致性重要

在视觉叙事中,一致性是信任的基础。当角色的脸在场景间变来变去——发型长度、眼睛形状、比例变化——观众会出戏。传统文生图并不确定:同样的提示每次可能生成不同的角色身份。LoRA训练把身份编码进可复用模型,让你的角色在各种变化下仍保持可辨识。

LoRA背后的科学原理

全量微调会重写模型的核心权重——代价高、容易过拟合且脆弱。LoRA只需保持基础模型不变,通过轻量适配器实现低秩更新。这样你的训练更有针对性(身份、风格、概念),参数更少、文件更小、速度更快——非常适合创作者反复迭代。

如何运作

几分钟即可上手,无需任何机器学习背景。

应用场景

创作者利用LoRA训练按需扩展产出,且不牺牲角色一致性。

LoRA训练流程

一致角色生成的实用工作流。

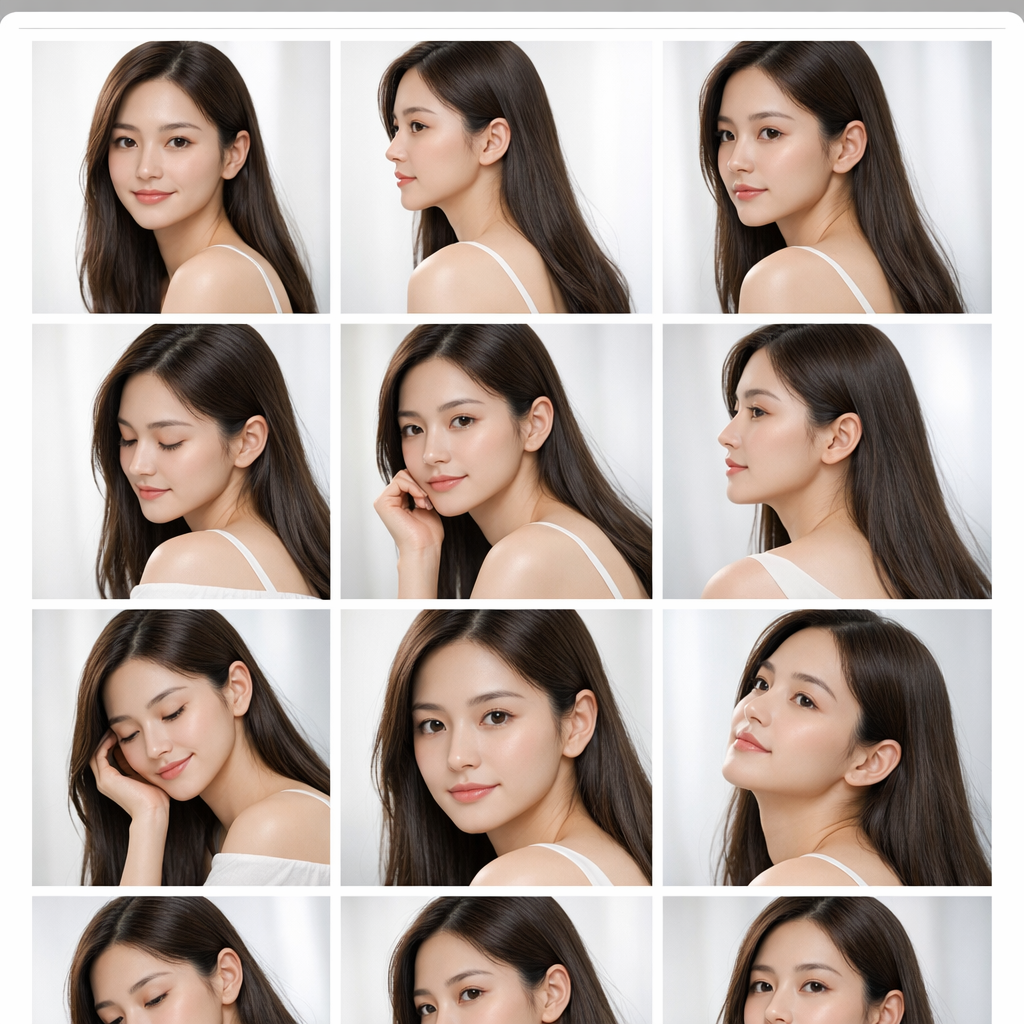

准备数据集

收集能代表同一身份的图片,覆盖不同角度、表情和光照。干净输入=更好一致性。

训练LoRA

运行轻量训练,学习身份/风格特征,避免过拟合。

生成一致作品

在角色工作室中用训练好的LoRA生成新场景、服装和姿势,保证脸部稳定不变。

为什么训练LoRA

一致性让精美图片真正成为可用故事流水线。

场景切换也恒定身份

换背景、摄像机视角或穿搭,角色脸始终不变。

加快迭代速度

身份一旦锁定,不用反复刷新直到对上角色。

系列连贯性更好

适用于漫画、网漫、缩略图及多图故事创作流程。

创作者级掌控

训练、测试、调整——目标是批量量产,而不是一次性演示。

资产可复用

把训练好的LoRA当作可复用的角色资产,随时用在新项目。

兼容角色工作室

直接前往/new/characters,生成、优化并持续扩充你的角色阵容。

常见问题

LoRA训练需要多少图片?

通常10–30张精选图片。保证角度、表情和光照多样,但身份绝对一致。数据质量永远优先于数量。

什么样的数据集才算好?

主体清晰、身份一致、视角多样、光照良好、裁剪紧凑。尽量避免混合对象、重滤镜、遮挡严重或同组中风格差异过大。

服装和场景切换还能保持角色一致吗?

可以——训练得当时,LoRA可让你在更换提示、服装、环境和光照时依然保持面部身份不变。

LoRA训练需要多久?

大部分训练15–30分钟内完成,具体依数据集数量和复杂度而异。

LoRA和全量微调有何区别?

全量微调会更新模型大部分权重(算力消耗大,易过拟合)。LoRA只学习轻量适配层(更快、更小、更易复用)。

可以组合多个LoRA模型吗?

常常可以。角色LoRA与风格LoRA叠加可以实现更深控制——稳定身份同时更换画风。

训练好的LoRA能商用吗?

你拥有在LlamaGen创作的内容。请确保你的数据集和提示尊重第三方版权和IP。

训练好的LoRA在哪里用?

在/new/characters打开角色工作室,用训练好角色身份生成新图片。